This article was originally published in English in October 2023. We have translated it into Spanish and are making it free to access due to the public interest in the material. You can read more about this project here.

Según un nuevo compilado de documentos revisado por 404 Media, el Servicio de Inmigración y Control de Aduanas (ICE, por sus siglas en inglés) ha usado anteriormente un sistema llamado Giant Oak Search Technology (GOST) para revisar publicaciones en redes sociales y determinar si se refieren a los Estados Unidos de forma “despectiva”, lo que puede ser usado para guiar decisiones migratorias.

Patrick Toomey, subdirector del Proyecto de Seguridad Nacional de la ACLU (Unión Estadounidense por las Libertades Civiles, según sus siglas en inglés), nos proporcionó estos documentos que provienen de una demanda presentada por la ACLU y su división del Norte de California amparados bajo la Ley de Libertad de Información (FOIA, por sus siglas en inglés). Estos documentos nos permiten dar un vistazo al funcionamiento tras bambalinas de un sistema muy poderoso, tanto en el sentido tecnológico como de las políticas empleadas: ¿cómo se procesa la información para decidir quién se queda en el país y quién se va?

“El gobierno no debería usar algoritmos para evaluar nuestras publicaciones en redes sociales y decidir quién representa ‘un riesgo’. Y ciertamente las agencias gubernamentales no deberían estar comprando este tipo de tecnologías de forma secreta y sin imputabilidad, especialmente porque sus criterios de operación son desconocidos. El Departamento de Seguridad Nacional le debe al público una explicación de cómo estos sistemas determinan quién ‘representa un riesgo’ y qué pasa con aquellas personas cuyas publicaciones son marcadas como problemáticas por los algoritmos”, señaló Patrick Toomey mediante un correo electrónico enviado a 404 Media.

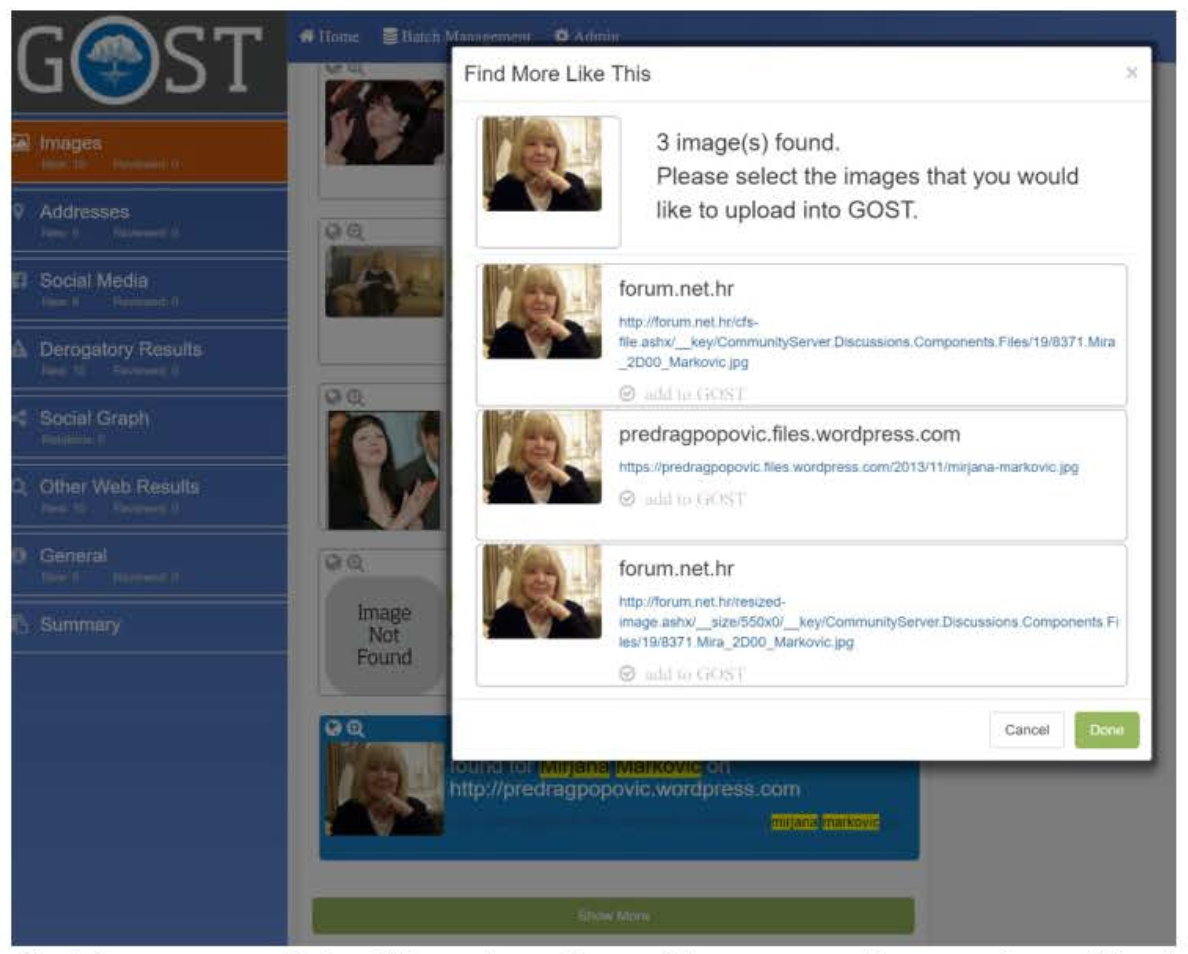

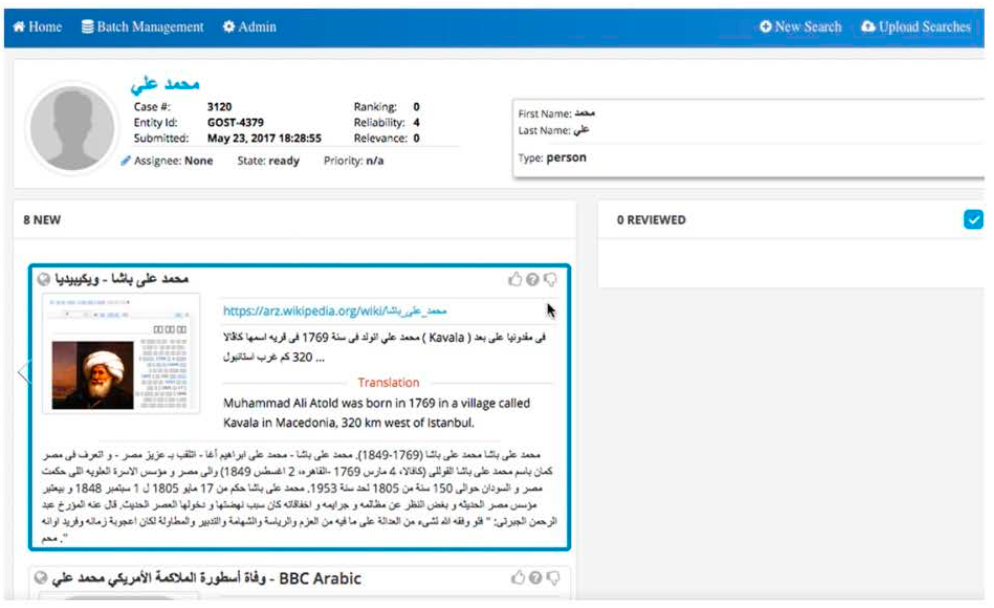

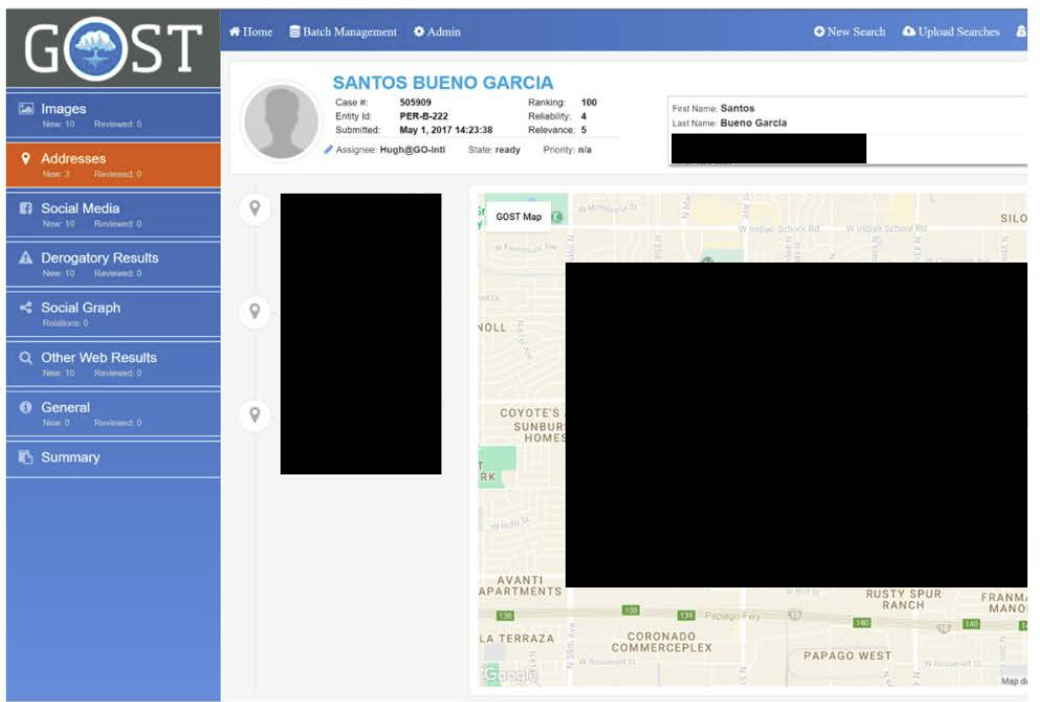

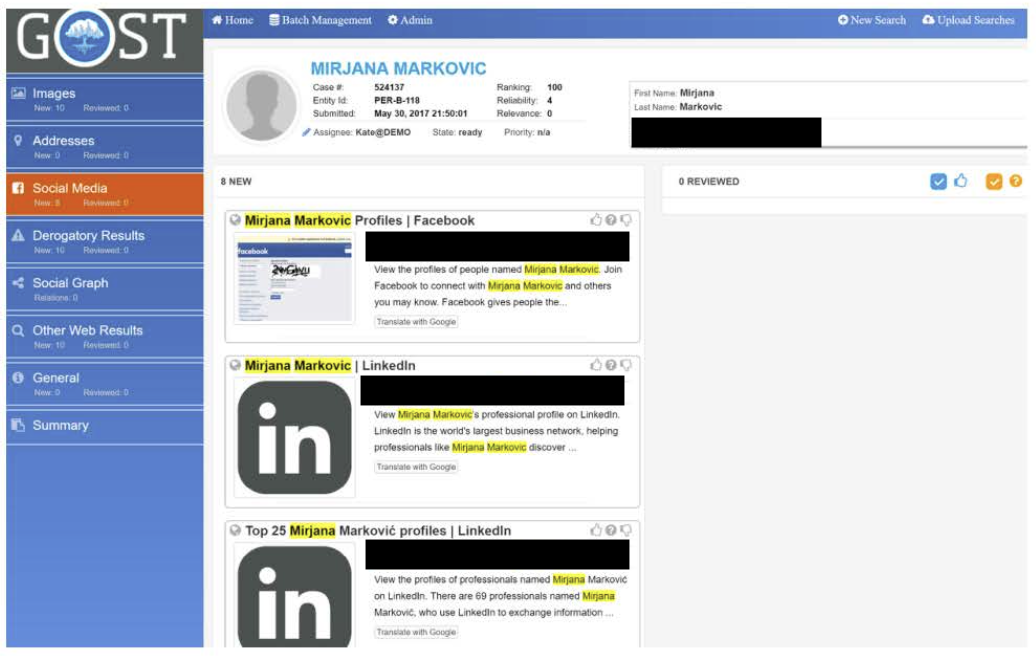

En uno de los documentos, se incluye un eslogan de GOST que reza: “We see the people behind the data” (“Desvelamos a las personas que se esconden tras los datos”). Los documentos también incluyen una guía de usuario de la herramienta en la que se indica que GOST “ofrece capacidades de búsqueda en línea basadas en conductas”. Capturas de pantalla incluidas muestran que los analistas pueden buscar en el sistema por identificadores como nombre, domicilio, dirección de correo electrónico y nacionalidad. Tras la búsqueda, el sistema GOST ofrece una “calificación” que va de 0 a 100, según lo que considera apropiado para la tarea del analista.

Los documentos indican además que “la interfaz permite revisar las publicaciones potencialmente despectivas publicadas por el postulante en redes sociales”, y basta un clic en el nombre de una persona para revisar imágenes obtenidas de redes sociales y otros sitios, las cuales se pueden calificar como “positivas” o “negativas”. Además, los analistas pueden revisar los perfiles en línea de los usuarios y consultar un “diagrama social” en el cual se muestran las personas que el sistema considera que podrían estar asociadas con el usuario objetivo.

Según una página del manual de usuario, el Departamento de Seguridad Nacional (DHS, por sus siglas en inglés) usa el sistema GOST desde el 2014, y existen registros públicos de contrataciones que dan cuenta que el ICE le ha pagado a la empresa dueña del sistema, Giant Oak Inc., más de 10 millones de dólares desde el 2017. Otros registros indican que un contrato entre Giant Oak y el DHS terminó en agosto del 2022. Los documentos también revelan una lista de los organismos gubernamentales que han emitido pagos a Giant Oak por sus servicios en los últimos diez años, la cual incluye a la Oficina de Aduanas y Protección Fronteriza (CBP, por sus siglas en inglés), la Administración de Control de Drogas (DEA, por sus siglas en inglés), el Departamento de Estado, la Fuerza Aérea y la Oficina del Servicio Fiscal (parte del Departamento del Tesoro de Estados Unidos).

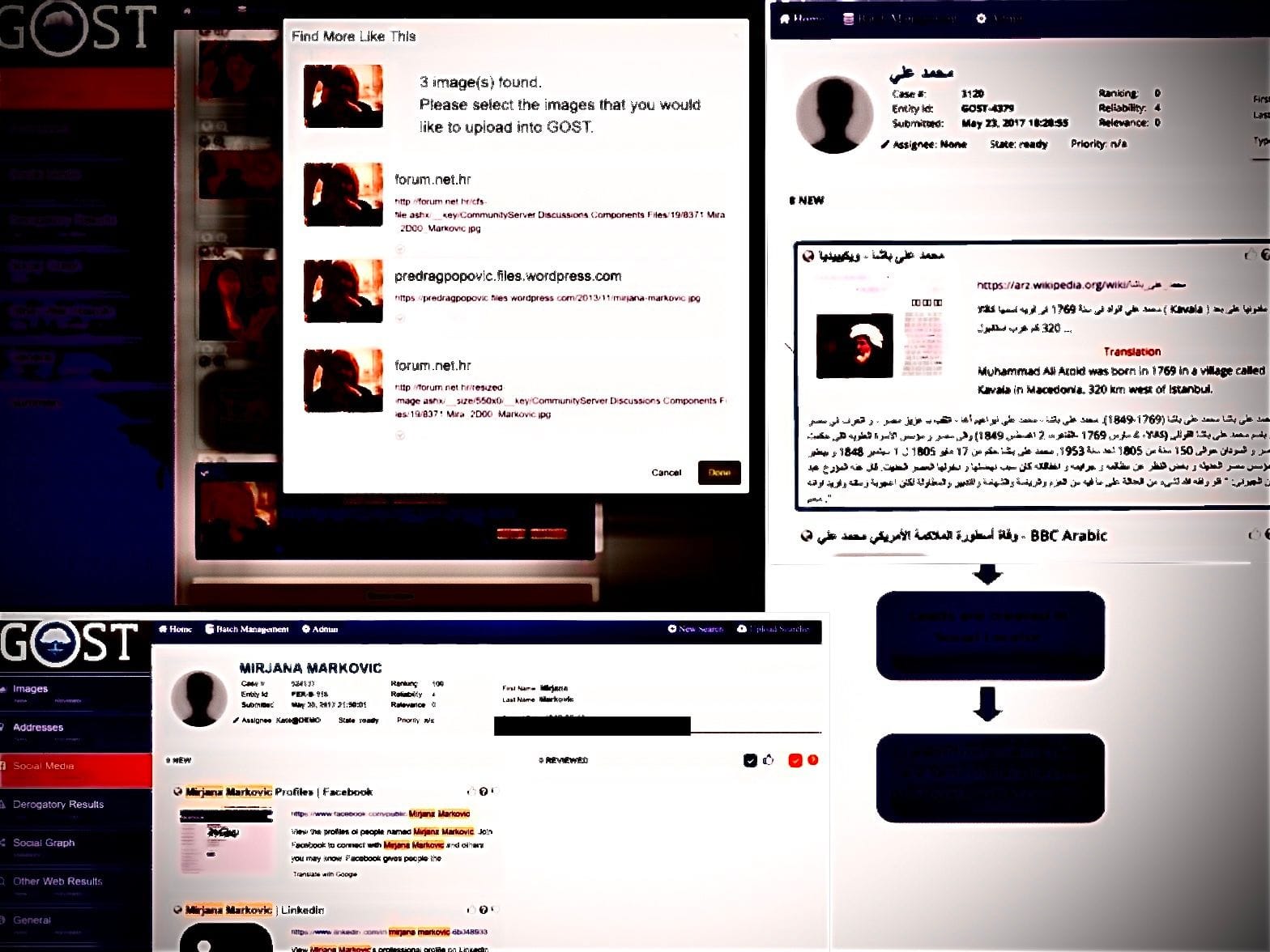

A SELECTION OF SCREENSHOTS OF THE GOST USER GUIDE. REDACTIONS BY 404 MEDIA. IMAGE: 404 MEDIA.

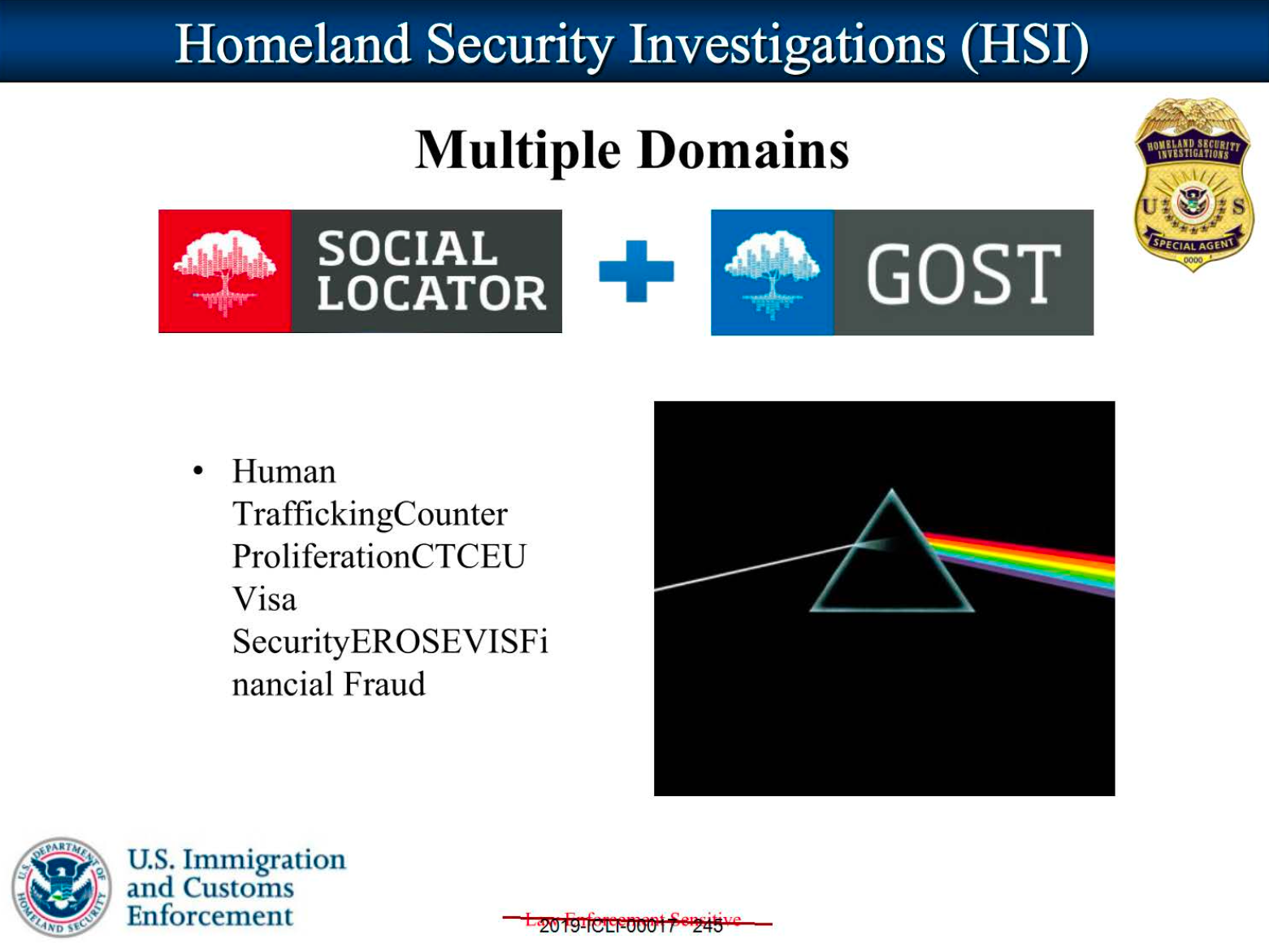

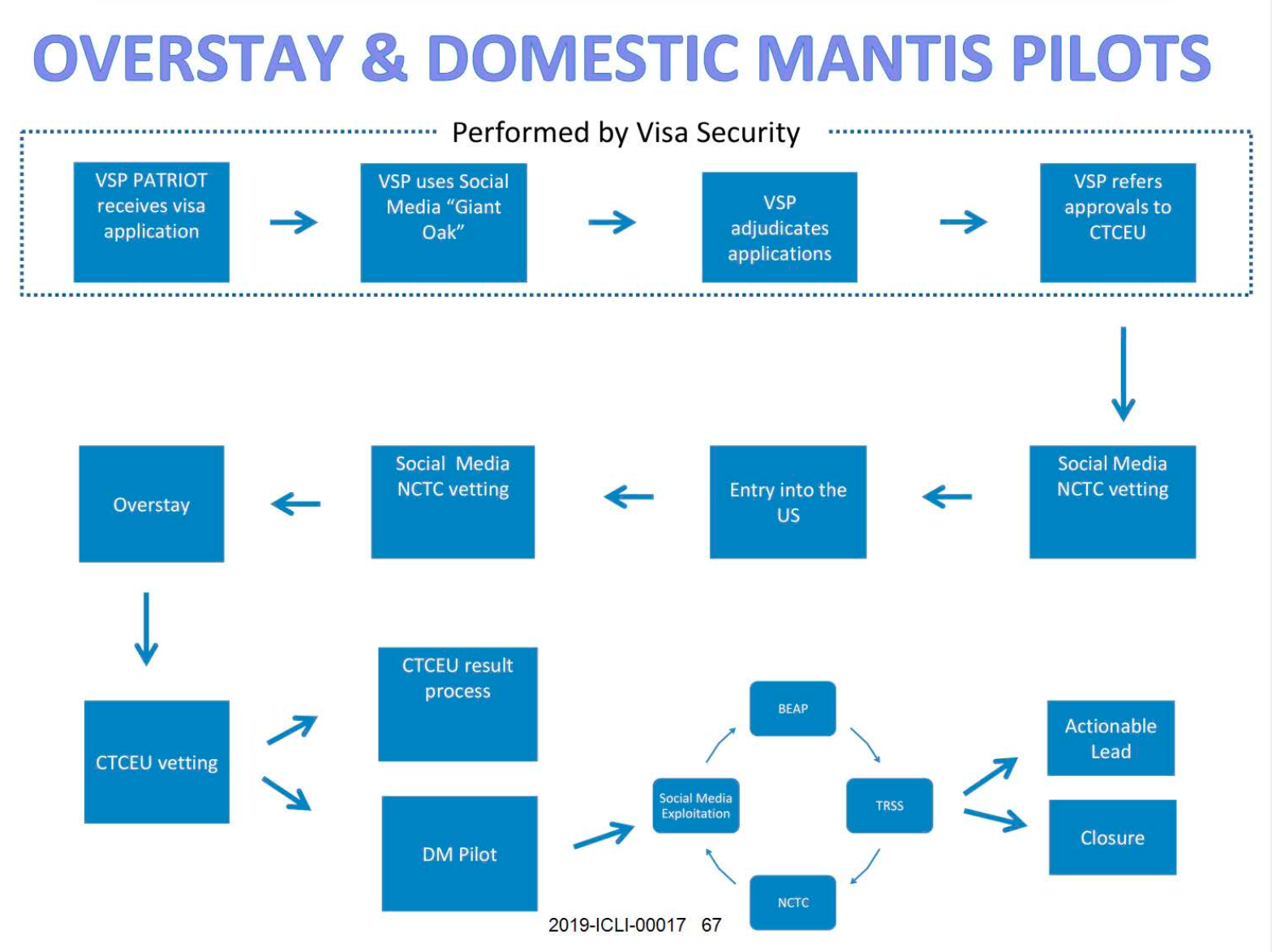

Los documentos obtenidos gracias a FOIA resaltan la relación de Giant Oak con un programa piloto del 2016 llamado “Programa Piloto de Redes Sociales PATRIOT de la HSI [Oficina de Investigaciones de Seguridad Nacional]”, mediante el cual se buscaba “identificar a posibles infractores de exceso de permanencia cuyas visas hubieran sido emitidas por oficinas de países considerados ‘preocupantes’.

“El objetivo de este programa piloto es aprovechar de mejor forma las redes sociales como herramienta útil para identificar el paradero y las actividades de personas que infringen las condiciones de su estatus migratorio, además de ofrecer más información sobre las publicaciones en redes sociales de visitantes no inmigrantes para beneficio de todo el proceso, desde la solicitud de visa hasta la admisión a los Estados Unidos, incluido su tiempo de permanencia en el país”, agrega el documento. En otras palabras, el sistema monitorearía las redes sociales para tomar decisiones de inmigración y emisión de visas. El documento agrega que “el proceso usa una plataforma automatizada de revisión de redes sociales que está diseñada para transmitirles información a los sistemas gubernamentales de los Estados Unidos durante el proceso de evaluación de visa y en el momento de realizar el viaje a los Estados Unidos. La plataforma puede ingerir datos biográficos y usarlos para buscar la presencia del usuario en redes sociales, y ayudar con la evaluación en el momento de la solicitud de la visa”. Un folleto del GOST incluido entre los documentos menciona que el sistema puede buscar tanto en la internet pública como en la “deep web”, un término genérico que hace referencia a toda clase de fuentes de información no indexadas, incluidas bases de datos comerciales y sitios hospedados en la red anónima Tor.

Como escribió anteriormente en el sitio de análisis jurídico Lawfare (sitio en inglés) la profesora adjunta de Fordham Law School, Chinmayi Sharma, PATRIOT es un sistema que hace referencias cruzadas de la información de los solicitantes de visas en diversas bases de datos gubernamentales para encontrar información que se considere peyorativa. El sistema “da como resultado una indicación de luz roja (negar la entrada de acuerdo con la información perjudicial encontrada) o luz verde (no se encontró información perjudicial) para el solicitante. Los funcionarios de la HSI siempre consultan la información del sistema PATRIOT antes de enviar sus valoraciones a los funcionarios consulares para que tomen la decisión final”. La profesora también menciona que el DHS se retractó en mayo del 2018 de una propuesta posterior que consideraba el uso de tecnología de aprendizaje automático para monitorear a los inmigrantes de forma continua. (Como se informó en mayo (sitio en inglés), la CBP sí está utilizando una herramienta de monitoreo con inteligencia artificial para evaluar a los visitantes).

A SELECTION OF SCREENSHOTS OF A PRESENTATION INCLUDED WITH THE DOCUMENTS. IMAGE: 404 MEDIA.

Los documentos también indican que la División de Investigaciones de Seguridad Nacional (NSID) estaba trabajando con Giant Oak en aquel entonces para “afinar el algoritmo de selección de objetivos y mejorar la capacidad del sistema para filtrar diversas convenciones de nombres de origen árabe”.

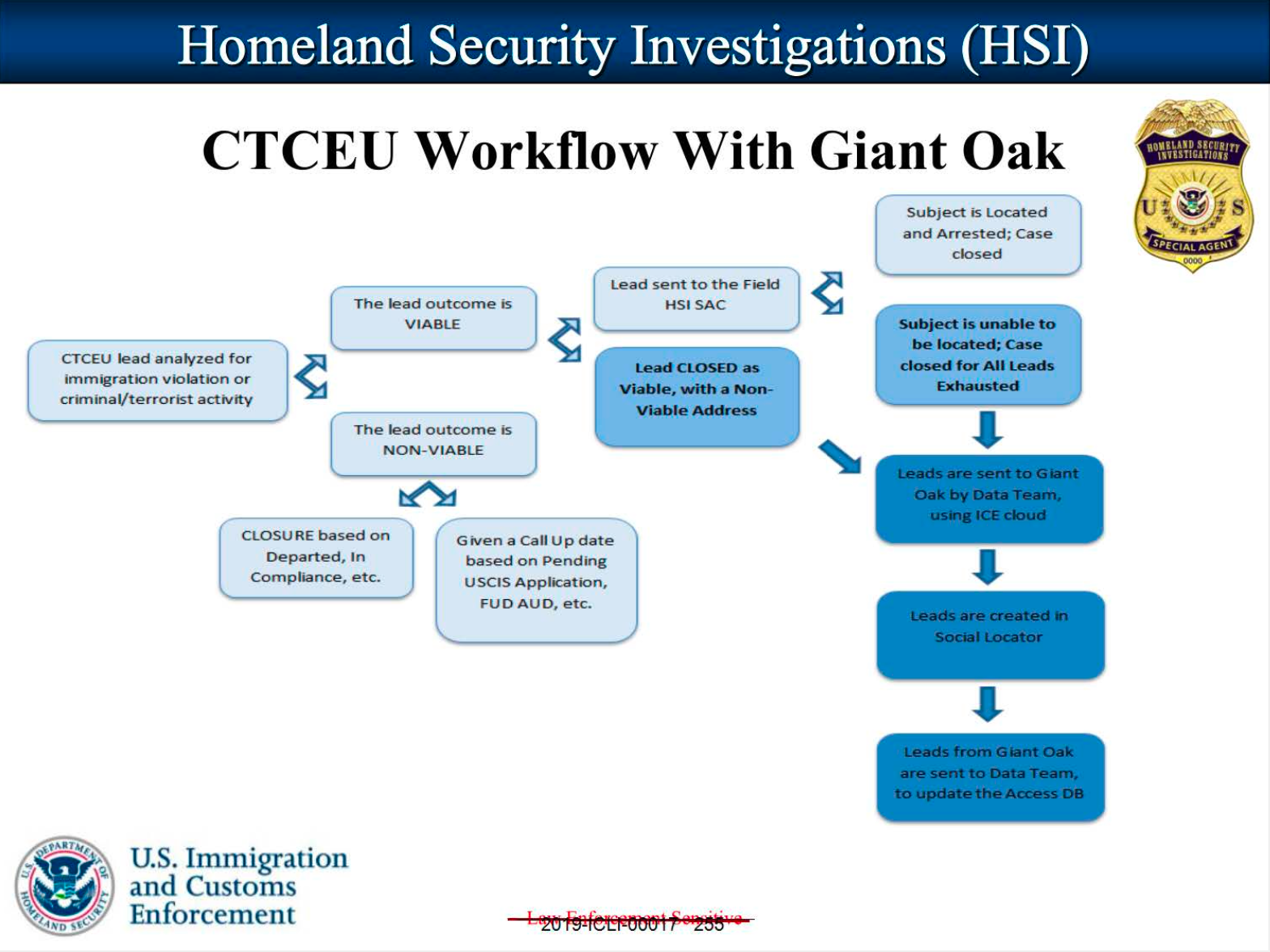

Una diapositiva incluida en los documentos explica cómo trabaja Giant Oak con la Unidad Contra el Terrorismo y la Explotación Criminal (CTCEU, por sus siglas en inglés) del ICE. En términos generales, los analistas primero revisaban si una pista relacionada con infracciones de inmigración o actividad terrorista era factible y luego la remitían a otra sección. Si el paradero del sujeto en cuestión era desconocido, se enviaba la información a Giant Oak para que buscara más pistas.

Una de las diapositivas señala que la División de Investigaciones de Seguridad Nacional (NSID, por sus siglas en inglés) estaba colaborando con Giant Oak para “afinar el algoritmo de selección de objetivos y mejorar la capacidad del sistema para filtrar diversas convenciones de nombres de origen árabe”.

Tras revisar los documentos, Julie Mao, cofundadora y subdirectora de Just Futures Law, declaró en un correo electrónico enviado a 404 Media que “la información genera preocupación de que ICE haya utilizado Giant Oak para rastrear de forma discriminatoria a comunidades árabes y personas provenientes de ciertos países”. Mao también entregó una copia de algunos documentos relacionados con GOST que su organización obtuvo a través de solicitudes FOIA.

En una entrevista del 2017 con Forbes (sitio en inglés), Gary Shiffman, director ejecutivo de Giant Oak, afirmó que la herramienta es capaz de hacer una “evaluación continua”. Esto significa que puede “analizar si hay un cambio en el patrón de comportamiento con el paso del tiempo”. En esa misma entrevista, Shiffman contó que trabajó en el proyecto Nexus 7, una herramienta de análisis de macrodatos utilizada en Afganistán. Forbes revela que Shiffman fue jefe de gabinete en la Oficina de Aduanas y Protección Fronteriza (CBP).

Giant Oak no respondió a las solicitudes de comentarios. ICE tampoco.